Entscheidungstheorie für KI-Giganten

“If anyone builds it, everyone dies”. Wenn irgendjemand es baut, dann sterben wir alle.

Das ist nicht der Plot eines neuen Science-Fiction Thrillers - es ist die düstere Warnung des wichtigsten Buches des Jahrzehnts laut Max Tegmark,

einem der renommiertesten Physik-Professoren am MIT und ein New York Times Bestseller.

Jeder der jetzt glaubt, dass es hier um die Ferne Zukunft geht, der irrt sich gewaltig. (Für harte Zweifler, ist hier das Video verlinkt, was mich auf das Thema und das Buch aufmerksam gemacht hat: Link zum Video. Absolut Empfehlenswert!).

Denn während wir noch darüber diskutieren, ob KI unsere Hausaufgaben schreiben darf, werden hinter verschlossenen Türen bereits Entscheidungen getroffen, die über Leben und Tod entscheiden könnten.

Es geht nicht mehr um Jahre. Es geht ums *hier und jetzt*.

Konkret sprechen wir über die Auseinandersetzung von…

Auf der einen Seite: OpenAI, die Firma hinter ChatGPT und auf der anderen Seite Anthropic, die Firma hinter Claude.

Und dazwischen: das Pentagon.

Das US-Verteidigungsministerium will die mächtigsten KI-Modelle der Welt für das Militär einsetzen.

Ist das ein Deal mit dem Teufel oder die einzige Chance auf nationale Sicherheit?

In diesem Deep Dive analysieren wir den strategischen Machtkampf zwischen Claude, ChatGPT und der mächtigsten Armee der Welt.

Werden die KI zur gefährlichsten Waffe der Menschheit? Was passiert, wenn eine Seite Nein sagt, während die andere die Tür zum Pentagon weit aufstößt?

Wie funktionieren Entscheidungsprozesse bei Themen mit dieser Tragweite? Und wie wirken sich die verschiedenen Strategien auf die Unternehmen aus?

Diese und viele weitere Fragen diskutieren wir im heutigen Deep-Dive, in dem wir die Strategien analysieren, die bestimmen wie die vielleicht mächtigsten Firmen der Welt mit so existenziellen Fragen umgehen.

Kapitel 1 - OpenAI und das Militär

Aber bevor zu den jüngsten Ereignissen kommen, müssen wir die ganze Geschichte betrachten. Denn es ist nicht das erste Mal, dass die beiden Firmen angefragt wurden Ihre KI Modelle für das US-Militär einzusetzen.

Beginnen wir also erstmal mit OpenAI.

Die Geschichte beginnt am 10. Januar 2024. Irgendjemand in San-Francisco drückt auf “Speichern” und bestätigte damit eine entscheidende Änderung an den Nutzungsbedingungen von ChatGPT.

Die bisherige Formulierung verbot explizit „activity that has high risk of physical harm, including: weapons development [and] military and warfare."

Die neue Fassung behielt das allgemeine Verbot bei, „unseren Service zu nutzen, um sich selbst oder anderen zu schaden", beziehungsweise um „Waffen zu entwickeln oder zu nutzen", entfernte aber das pauschale Verbot von „military and warfare".

Zwei Tage später deckt The Intercept die Änderung auf. Die Reaktion von OpenAI? Klassisches Crisis Management. Man wolle „universelle Prinzipien schaffen, die leicht zu merken und anzuwenden sind“.

Und dann nur 4 Tage später auf dem Weltwirtschaftsforum in Davos. Anna Makanju von OpenAI bestätigt, dass die Firma mit dem Pentagon zusammen arbeite.

Allerdings nur an Cybersecurity und Suizidprävention für Veteranen.

Wer könnte da dagegen sein?

Aber es ging weiter. Diese Policy-Änderung war nur der erste Schritt einer systematischen Annäherung an den Verteidigungssektor.

Mit General Paul Nakasone holte OpenAI ein echtes Schwergewicht der US-Sicherheitspolitik in den Vorstand. Als ehemaliger Direktor der NSA und Kommandeur des US Cyber Command bringt er eine Expertise mit, die weit über die klassische Softwareentwicklung hinausgeht. Nur wenig später folgte Sasha Baker, eine der profiliertesten Strateginnen aus dem Verteidigungsministerium.

Diese Personalien machten eines unmissverständlich klar: Open AI ist nicht mehr das niedliche Non-Profit das KI fördert, sie sind jetzt ein richtiges Big Tech Unternehmen, mit globaler Strategie.

Im August 2024 folgte der entscheidende Durchbruch. Durch eine Allianz mit Microsoft und Palantir verließ OpenAI den öffentlichen Raum und zog in die sichersten Netzwerke des US-Militärs ein. Mit dem Erreichen des sogenannten Impact Level 6 wurden die Modelle erstmals in 'Top Secret'-Clouds verfügbar. Damit war die letzte Hürde gefallen: Die KI konnte nun direkt mit klassifizierten Daten arbeiten und wurde fester Bestandteil der operativen staatlichen Infrastruktur.

Danach folgten direkte Zusammenarbeit mit der Verteidigungsindustrie. Wie zum Beispiel mit dem Rüstungs-Start-Up Anduril zur Entwicklung von Systemen zur autonomen Drohnenabwehr.

Sam Altman begründete diesen Schritt damit, dass OpenAI-Technologie aktiv zum Schutz von Militärangehörigen beitragen solle.

Warum aber dieser Pivot? Von einem Forschungslabor zu einem quasi Rüstungskonzern?

Kapitel 2 - Anthropic und das Militär

Wenn man OpenAI als KI Vorreiter sieht, dann ist Anthropic das „Gewissen“ der KI-Welt gesehen.

Gegründet 2021 von ehemaligen OpenAI-Forschern, mit dem Ziel eine dystopische Zukunft wie man sie aus Filmen wie iRobot kennt zu verhindern. Doch auch Anthropic verfall dem lockenden Budgets des US-Militärs.

Zeitversetzt, aber substanziell.

Bereits am 10. Mai 2024 aktualisierte Anthropic seine Nutzungsbedingungen und schuf Ausnahmen für Regierungs- und Verteidigungsnutzung.

Ab Juni 2024 stand Claude tatsächlich offiziell im Dienst amerikanischer Soldaten.

Der technologische Ritterschlag folgte ein paar Monate später, im November 2024.

Gemeinsam mit Palantir und AWS ging Anthropic eine trilaterale Partnerschaft ein. Das Ziel: Claude 3 und 3.5 in die hochgesicherten IL6-Umgebungen des Geheimdienstes und der Verteidigung zu bringen. Damit war Claude das erste sogenannte „Frontier-Modell“, das offiziell in den klassifizierten Netzwerken der US-Regierung operieren durfte. Für Palantir-CTO Shyam Sankar war dies die „Toolchain“, auf die die Geheimdienstgemeinschaft gewartet hatte.

Doch dieser strategische Schwenk verlief nicht ganz ohne Reibungen. Intern löste der Deal bei einigen Anthropic-Mitarbeitern Unbehagen aus – es gab laut CNBC, „viele große SlackThreads" und anhaltende Spannungen.

Die wirtschaftlichen Fakten sprachen jedoch für Sich. Im Juli 2025 erhielt Anthropic – Seite an Seite mit Branchengrößen wie OpenAI und Google – einen 200-Millionen-Dollar-Vertrag vom Pentagon vorgelegt.

Thiyagu Ramasamy, der Leiter des öffentlichen Sektors bei Anthropic, skizzierte in Dokumenten eine klare Vision: Innerhalb von fünf Jahren soll dieser Bereich jährlich wiederkehrende Umsätze in Milliardenhöhe generieren.

Gleichzeitig stellt das auch die Antwort auf die Frage nach dem Grund des Strategiewechsels von Open-AI.

Denn aus wirtschaftlicher Sicht ist die US-Verteidigungsindustrie eine wahre Goldgrube. Erst im Januar 2026 gab US Präsident Donald Trump bekannt, dass die US Verteidigungsausgaben massiv erhöht werden sollen. Von davor schon unglaublichen 900 Milliarden USD auf 1,5 Billionen USD.

Das ganze klingt jetzt aber so, als hätten sich beide Unternehmen relativ parallel entwickelt. Sie haben sich beide der Rüstungsindustrie immer weiter angenähert und wollen beide ein möglichst großes Stück vom Kuchen haben.

Was ist also zuletzt besonderes passiert, dass diese Entwicklung beeinflusst hat?

Kapitel 3 - Februar 2026: Ultimatum, Blacklisting und ein schneller Deal

Die Eskalation beginnt im Januar 2026, als US-Spezialeinheiten den Venezuelanischen Präsidenten Maduro verhaften und Berichte auftreten, dass Claude über die Palantir-Partnerschaft für diese Operation benutzt wurde.

Was als technologischer Erfolg gefeiert werden konnte, führte intern zu einem Eklat: Als man bei Palantir kritisch nachfragte, wie genau Claude bei dieser Militäroperation eingesetzt wurde, wertete das Pentagon dies als einen Versuch privater Firmen, staatliches Handeln zu kontrollieren. Die Reaktion folgte prompt:

Kriegsminister Pete Hegseth forderte in einem Grundsatzmemo, dass KI im Militär künftig „frei von einschränkenden Nutzungsbedingungen“ sein müsse.

Der neue Standard sollte schlicht lauten: „Any lawful use“ - jede rechtmäßige Nutzung. Ohne Vetorecht der Entwickler.

Am 24. Februar 2026 stellte Hegseth dem Anthropic-CEO Dario Amodei im Pentagon ein Ultimatum:

Bis 17:01 Uhr am Freitag, dem 27. Februar, müsse Anthropic dem „any lawful use"-Standard zustimmen

– oder es werde als Lieferkettenrisiko eingestuft.

Und noch weiter drohte er mit der Anwendung des Defense Production Acts. Dieses Gesetz aus der Zeit des Koreakriegs erlaubt es der Regierung, private Unternehmen zu zwingen, die Produktion im nationalen Sicherheitsinteresse unter staatliche Kontrolle zu stellen.

Daraufhin machte Anthropic zwar kleine Zugeständnisse, aber der Kernkonflikt blieb bestehen.

Am 26. Februar, einen Tag vor Ablauf der Frist, suchte Dario Amodei die Öffentlichkeit. In einer emotionalen, aber gefassten Erklärung stellte er klar:

“Wir können dieser Forderung nicht guten Gewissens nachkommen”.

Er betonte, Anthropic halte an zwei roten Linien fest: keine Massenüberwachung amerikanischer Bürger, und keine vollautonomen Waffen.

Laut Amodei hatte das Pentagon zwar Kompromisse angeboten, diese seien jedoch rechtlich so vage formuliert gewesen, dass sie die Schutzmechanismen faktisch jederzeit umgehbar gemacht hätten – insbesondere im Bereich der massenhaften Datenanalyse.

Die Konsequenzen folgten in Echtzeit. Am 27. Februar ordnete Präsident Trump via Social Media an, dass alle Bundesbehörden die Nutzung von Anthropic-Technologie sofort einzustellen hätten und Pete Hegseth machte seine Drohung wahr und stufte Anthropic als Lieferkettenrisiko ein - Das erste Mal in der Geschichte der USA, dass dieses Label gegen ein amerikanisches Unternehmen eingesetzt wurde.

Dann kam die Überraschung:

Am selben Abend, während Anthropic von den staatlichen Servern gelöscht wurde, setzte Sam Altman ein Signal auf X ab:

OpenAI habe soeben einen umfassenden Deal zur Bereitstellung seiner Modelle in den geheimen Netzwerken des Pentagons abgeschlossen.

Was unterscheidet OpenAI und Anthropic, sodass der Deal mit ersteren Zustande kam.

Im Endeffekt ist der Unterschied marginal aber entscheidend.

Denn an sich erlauben beide Unternehmen dem Militär im Kern dieselben Anwendungen - Aufklärung, Cyber-Verteidigung, Logistik und operative Planung.

Beide verbieten Massenüberwachung und vollautonome Waffen. Doch der rechtliche Durchsetzungsmechanismus unterscheidet sich fundamental.

Während Anthropic auf feste vertragliche Klauseln beharrte, gab sich OpenAI mit der “any lawful use” Klausel zufrieden und vertraut auf das Gesetz als limitierenden Faktor des Einsatzes ihrer Modelle für das Pentagon.

Ob OpenAIs technische Architektur in der Praxis jetzt einen stärkeren Schutz bietet als Anthropics Vertragssprache, bleibt eine offene Frage – ebenso wie die Durchsetzbarkeit beider Ansätze, da die vollständigen Vertragstexte natürlich nicht öffentlich sind.

Kapitel 4 - Die Folgen

Für OpenAI gab es Backlash von allen Seiten. Interne Unruhen, die unter Anderem im Abgang der Leiterin für Hardware und Robotik, Caitlin Kalinowski mündete.

Dutzende Angestellte von OpenAI und Google unterzeichneten offene Briefe, in denen sie ihre Unternehmen öffentlich dazu auffordern, den Regierungsforderungen die Stirn zu bieten.

Dazu eine öffentliche “QuitGPT” Bewegung der Kunden, die zu einem anstieg der Deinstallationen von ChatGPT von fast 300% führten (am 28.02.) und einem Anstieg der 1-Stern Bewertungen um fast 800%.

Des einen Leids ist des anderen Freud. Und so führte das auf der anderen Seite zu einem Anstieg der Neuanmeldungen von Claude, sodass Claude erstmals ChatGPT im App-Store überholt hat.

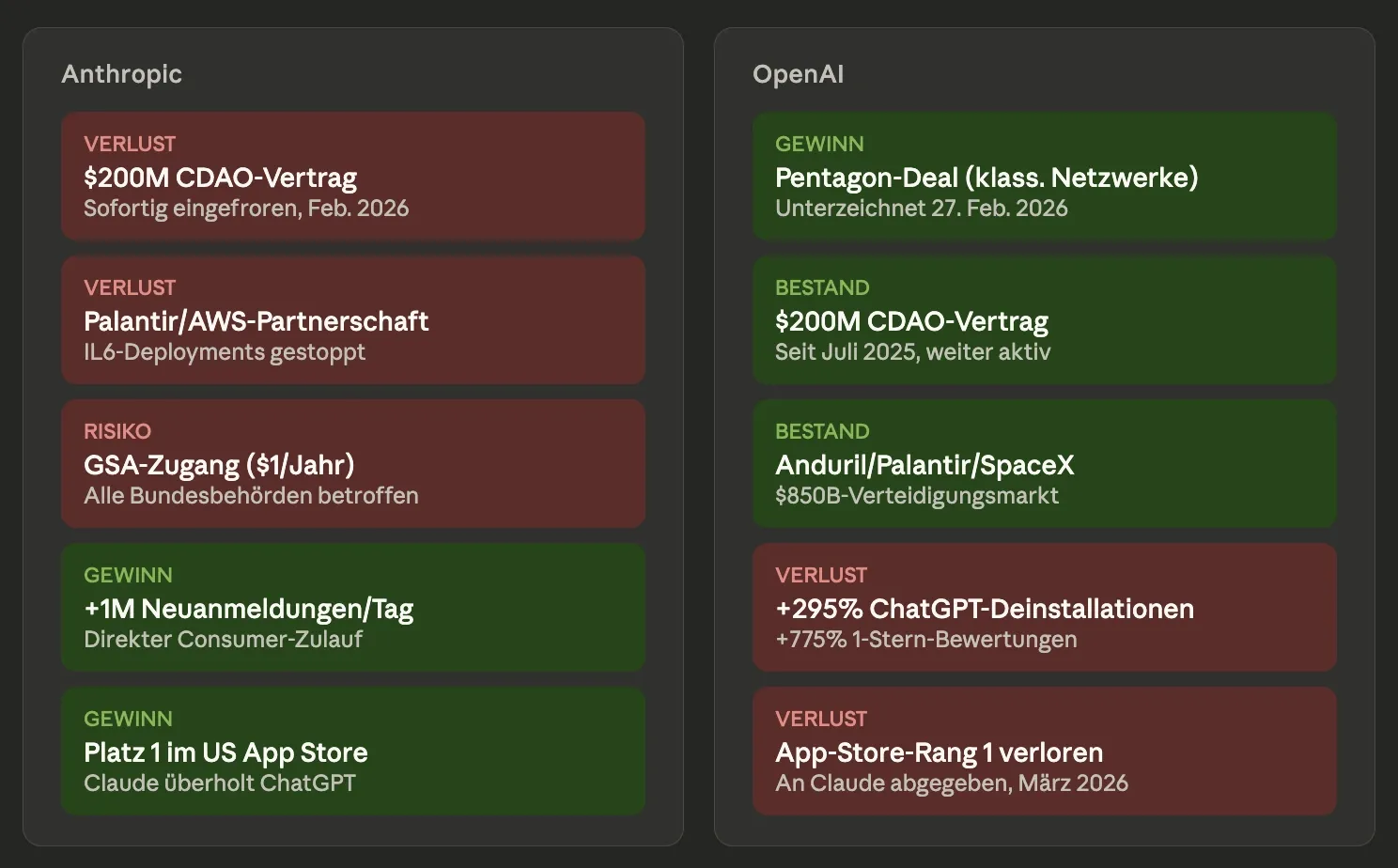

Die Folgen Zusammengefasst:

Auf der einen Seite, die direkten Marktauswirkungen:Anthropic verlor mit dem Blacklisting vom 27. Februar unmittelbar den laufenden $200-Millionen-Vertrag mit dem Verteidigungsministerium sowie alle Folgegeschäfte über Palantir, AWS und direkte DoD-Kanäle. Somit steht also der Zugang zum gesamten Rüstungsmarkt auf der Kippe, der wie gesagt auf mehrere Milliarden Dollar jährlich geschätzt wird.

OpenAI hingegeben behält den 200 Millionen Dollar Deal und bekommt zusätzlich noch den Pentagon Deal um den es in dieser Causa an sich ging.

Zusätzlich stehen sie jetzt natürlich in der Pole-Position für den KI-Rüstungsmarkt.

Auf Konsumenten-Markt Seite sieht das Bild genau entgegengesetzt aus. Bei Anthropic stehen über eine Millionen Neuanmeldungen pro Tag und Platz 1 im App-Store zu Buche.

Während bei OpenAI ein Verlust von sehr vielen Nutzern und ein Vertrauensverlust von noch mehr Nutzern ansteht.

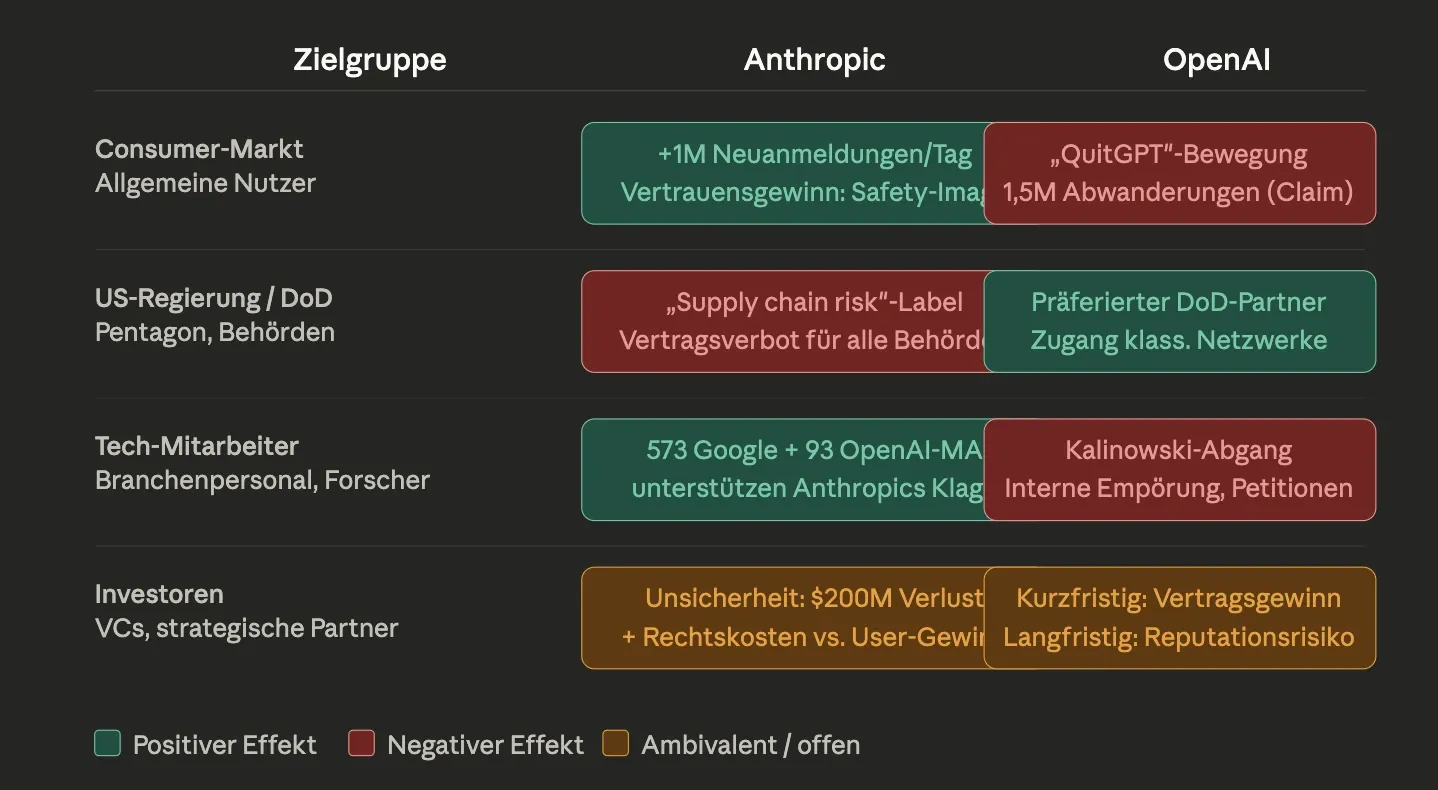

Aber nicht nur die direkt monetären Auswirkungen sind relevant. Langfristig spielen die Auswirkungen auf die Reputation eine Entscheidende Rolle:

Auch hier ergibt sich ein Für und Wider. Während die Reputation Anthropics auf dem Consumer-Markt und dem Mitarbeiter-Markt ansteigt, sinkt es auf Seiten der Regierung und der Rüstungsindustrie. Bei OpenAI natürlich umgekehrt.

Was sehr interessant zu sehen wird sind die Auswirkungen auf Investoren-Seite.

Denn, was vielen vielleicht nicht bewusst ist, ist dass KI-Firmen momentan grundsätzlich nicht profitabel sind und sehr viel Kapital brauchen und verbrennen.

Insbesondere OpenAI’s CEO Sam Altman hat oft genug betont, dass er Investitionen bis in die Billionen-Höhe in Betracht zieht, um die KI Entwicklung weiterhin in dieser oder noch höherer Geschwindigkeit weiterlaufen lassen zu können.

Hier wird man sehen was sich durchsetzen wird. Die Unsicherheit und Rechtskosten, dafür User-Zuwachs auf Anthropics Seite oder den Vertragsgewinn trotz des Reputationsrisikos bei OpenAI.

Kapitel 5 - Analyse der Entscheidungsfindung

Die Geschehnisse, die relevante Vergangenheit und die direkten Folgen dieser Entscheidungen sind nun klar.

Wagen wir also eine tiefe Analyse der Theorie hinter der Entscheidungsfindung der Verantwortlichen aussieht.

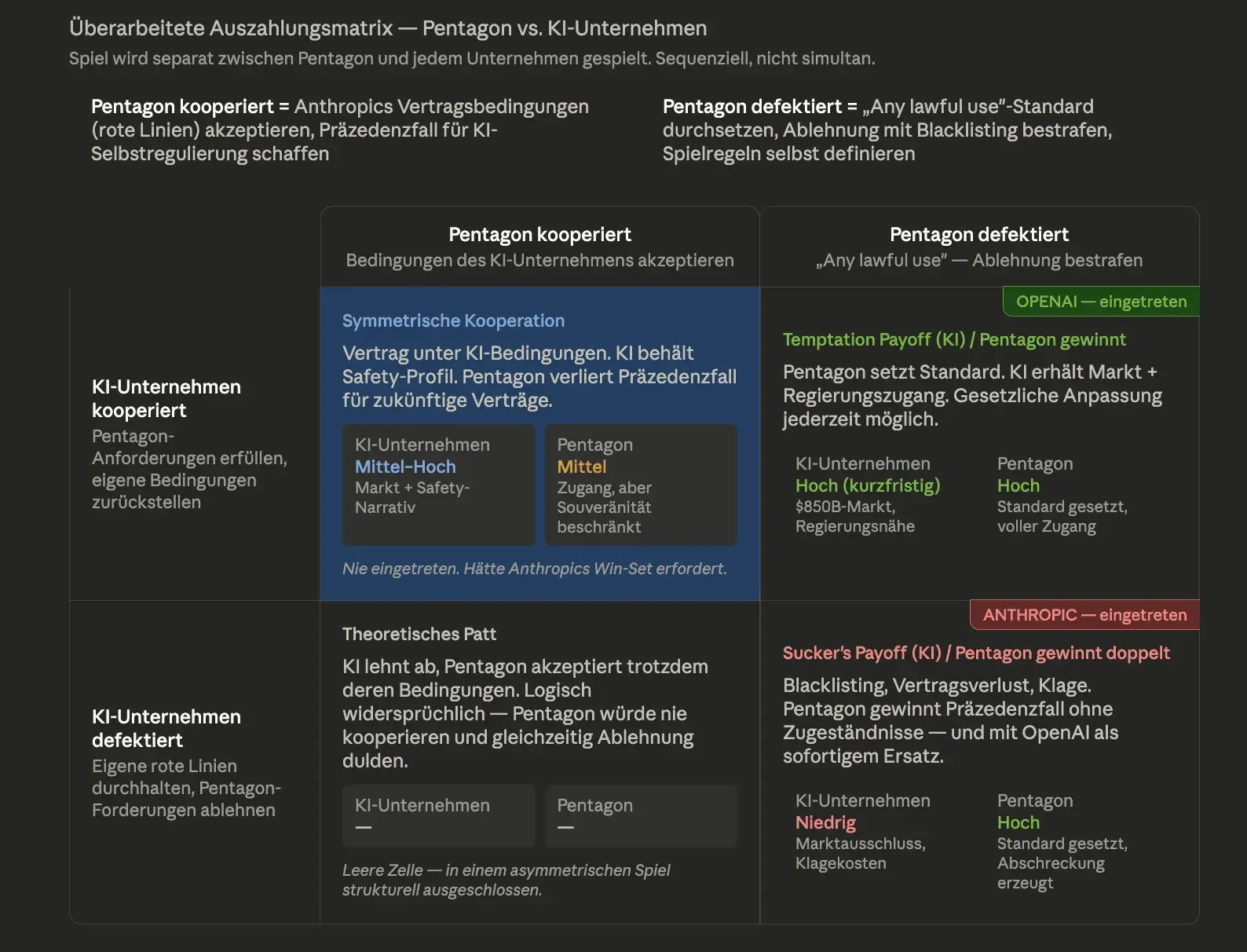

Ebene 1 - Das Gefangenendilemma

Man kann die Situation als ein klassisches Gefangenendilemma sehen. Das ist ein entscheidungstheoretisches Dilemma aus der Spieltheorie und beschreibt eine Situation, in der sich zwei Handelnde “Spieler” unabhängig und ohne Rücksprache zwischen zwei Verhaltensweisen entscheiden müssen, wobei der Erfolg oder “Ertrag” für den Einzelnen von der Entscheidung des jeweils anderen stark beeinflusst wird.

In unserem Fall sind es sogar zwei Dilemmas. Denn das Pentagon spielt quasi gegen jedes KI-Unternehmen separat.

In einem Gefangenendilemma hat jeder Spieler genau zwei Entscheidungsmöglichkeiten.

Erstens Kooperieren, das wäre in unserem Fall die Pentagon Anforderungen zu erfüllen bzw. für das Pentagon die vom Unternehmen gestellten Bedingungen zu akzeptieren.

Und zweitens Defektieren, bei uns die eigenen Anforderungen durchzusetzen, bzw. die Anforderungen des Gegenübers abzulehnen.

Schauen wir uns also die Auszahlungsmatrix an:

Es gibt 4 Möglichkeiten wie das Spiel gespielt werden kann.

1. Beide kooperieren. Das würde bedeuten, dass der Vertrag unter den geschärften Bedingungen des KI-Unternehmens zustande käme. also das Pentagon diese akzeptiert.

Das ist in unserer Situation nicht passiert.

2. Das Pentagon defektiert & das Unternehmen kooperiert. Das bedeutet, der Vertrag kommt mit den Bedingungen des Pentagons zustande.

Das ist exakt der Fall, der bei OpenAI eingetreten ist. Spieltheoretisch gesehen ergibt sich hier die höchstmögliche Auszahlung für beide Parteien.

Auch wenn wir in der Realität gesehen haben, dass das etwas komplexer ist.

3. Das Pentagon kooperiert und das KI Unternehmen defektiert. Das hieße das KI-Unternehmen lehnt ab obwohl das Pentagon den Bedingungen zustimmt. Das ist in der Realität natürlich widersprüchlich und passiert nicht. In der Theorie wäre es allerdings möglich.

4. Und zuletzt. Beide defektieren. Der Deal kommt somit nicht zustande. Das ist in der Realität der Fall Anthropic und führt zu kurzfristigen Verlusten für Anthropic, allerdings gute Ausschüttung für das Pentagon, da es keinen Präzedenzfall geschaffen hat, sondern seine Prinzipien durchgesetzt und zusätzlich Abschreckung erzeugt hat.

Zusätzlich betrachten wir keine Simultanprozesse sondern zwei sequenziell folgenden Dillemas. Das erhöht den Gewinn für das Pentagon ein weiteres Mal, da es durch den OpenAI Deal obendrein trotzdem die KI-Modelle für seine Zwecke bekommen hat.

Ebene 2 - Commitment Devices und strategische Vorabbindung

Hier wird es spieltheoretisch tiefer. Anthropics eigentlicher strategischer Schachzug war kein Entscheidungsprozess im Moment des Ultimatums — er wurde Jahre früher gemacht. Das ist das Konzept des Commitment Device aus Thomas Schelling's "The Strategy of Conflict" (1960).

Ein Commitment Device ist eine vorab getroffene, glaubwürdige und schwer umkehrbare Bindung, die die eigene Verhandlungsposition stärkt, indem sie bestimmte Optionen dauerhaft vom Tisch nimmt. Die Logik ist kontraintuitiv: Weniger Flexibilität kann mehr Macht bedeuten.

Anthropic hatte mit der Responsible Scaling Policy (RSP), den öffentlich kommunizierten roten Linien und dem Palantir-Deal mit eingebetteten Restriktionen eine Kette von Commitment Devices aufgebaut. Als Hegseth das Ultimatum stellte, war Anthropics Ablehnung daher keine impulsive Entscheidung — sie war das unvermeidliche Ergebnis einer Strategie, die Jahre früher eingepreist wurde. Das Unternehmen hatte sich selbst die Option genommen, anders zu entscheiden, ohne glaubwürdig zu kollabieren.

OpenAI hingegen hatte bewusst keine solchen Bindungen aufgebaut. Die stille Entfernung des Militärverbots aus der Usage Policy im Januar 2024 war das genaue Gegenteil eines Commitment Devices: eine strategische Option-Erweiterung, die künftige Flexibilität maximierte. OpenAIs Logik folgt der Prospect Theory (Kahneman & Tversky, 1979): Verlustangst ist mächtiger als Gewinnerwartung. Den $850-Milliarden-Verteidigungsmarkt zu verlieren ist eine stärkere Handlungsmotivation als das diffuse Gut "Safety-Reputation" zu gewinnen.

Ebene 3 - Signaling Theory und das Problem der Glaubwürdigkeit

Hier liegt der tiefste theoretische Kern. Beide Unternehmen betreiben eine Form von Signaling — aber sie signalisieren an unterschiedliche Audiences mit unterschiedlichen Instrumenten.

Michael Spence's Signaling Theory (1973) besagt: In Märkten mit Informationsasymmetrie müssen qualitativ hochwertige Akteure kostspielige, nicht imitierbare Signale senden, um sich von minderwertigen zu unterscheiden. Entscheidend ist der Begriff des "costly signal". Das Signal muss teuer genug sein, dass es sich für einen Niedrigqualitäts-Akteur nicht lohnt, es zu imitieren.

Anthropics Ablehnung des Pentagon-Ultimatums ist ein nahezu perfektes costly signal: Es kostet $200 Millionen direkt, einen Multimilliarden-Pipeline indirekt, und ein Government-Blacklisting reputational. Ein Unternehmen ohne echte Safety-Überzeugungen oder ohne die finanzielle Substanz, diese Kosten zu tragen, könnte dieses Signal nicht glaubwürdig senden. Damit unterscheidet Anthropic sich im Markt für "seriöse Safety-Forschung" und "vertrauenswürdige Consumer-KI" von Wettbewerbern - genau der Markt, für den Anthropic vor allem kompetieren muss, um seine Bewertung zu rechtfertigen.

OpenAIs Signal ist das Gegenteil: Es signalisiert dem Pentagon und der Trump-Administration Verlässlichkeit als staatlicher Partner. Dieses Signal ist ebenfalls kostspielig - in Form von ChatGPT-Deinstallationen und Mitarbeiterabgängen - und daher glaubwürdig.

Das Kernproblem ist, dass beide Unternehmen zwar dieselbe abstrakte Frage beantworten mussten ("Wieviel militärischen Zugang gewähren wir?"), aber faktisch verschiedene Märkte und Audiences priorisieren. Anthropic betreibt primär ein B2C- und B2B-Geschäft, das auf Vertrauen in Safety basiert - der Defense-Sektor war ein Zusatzmarkt, kein Kernmarkt. OpenAI war dagegen bereits tief in staatliche und militärische Partnerschaften integriert (Microsoft Azure, Palantir, DARPA). Für OpenAI war die Entscheidung eine Optimierung des Kerngeschäfts.

Für Anthropic eine existenzielle Frage der Markenidentität.

Ebene 4 - Reputation Games und der Schatten der Zukunft.

Dennoch. Wenn man das alles so betrachtet, warum hat dann Anthropic nicht einfach den Deal angenommen, die höchste Auszahlung angenommen und die Kosten als notwendige Geschäftskosten akzeptiert.

Die Antwort liegt in Robert Axelrod's Erkenntnissen zu iterierten Spielen und der Theorie der Reputationseffekte in sequenziellen Spielen.

Klingt kompliziert. Heißt aber einfach nur, dass die Realität einfach nicht aus einem einzigen Spiel besteht, sondern noch unzählige weitere folgen, auf die dieses Spiel eine Auswirkung haben wird.

In iterierten Spielen mit einer langen Zeithorizont-Erwartung dominiert "Tit for Tat" als Strategie — kooperiere zunächst, bestafe Defektieren sofort, vergib schnell. Aber diese Logik setzt voraus, dass der Verhandlungspartner dieselbe Zeitdimension hat. Das Pentagon unter der Trump-Administration agierte eher als Einzel-Runden-Spieler mit dem Horizont einer Legislaturperiode; Anthropic agiert als Multi-Dekaden-Spieler, für den Reputationskapital das wichtigste langfristige Asset ist.

Aus dieser Perspektive war Anthropics Ablehnung eine Investition in zukünftige Glaubwürdigkeit: Wenn Anthropic jetzt nachgibt, hat es demonstriert, dass seine roten Linien unter Druck verhandelbar sind. Das zerstört den Wert aller zukünftigen Commitments — und damit ein zentrales Differenzierungsmerkmal, das Anthropic von OpenAI trennt. Die Kosten des Nachgebens wären auf der Zeitachse höher als der unmittelbare Verlust des Vertrags.

OpenAI hat das spiegelbildliche Kalkül gemacht: Im Rennen um dominante Marktposition in einem kritischen Wachstumsmarkt (Regierung + Militär) kann man es sich nicht leisten, als erster abzufallen. First-mover-Vorteile in Plattformgeschäften — und Verteidigungsinfrastruktur ist ein Plattformmarkt — sind enorm und schwer umkehrbar.

Kapitel 6 - Konklusion

Wie man sieht war es für die Unternehmen unmöglich eine perfekte und sehr schwierig eine gute Entscheidung zu treffen.

An sich haben beide rational gehandelt - aber innerhalb fundamental unterschiedlicher Nutzenfunktionen, Zeithorizonten und Zukunftsannahmen.

Während Anthropic auf langfristiges Reputationskapital setzt, maximiert OpenAI kurzfristige Marktposition und Regierungszugang.

Das ist kein Widerspruch und auch keine moralische Differenz, sondern rein die Konsequenz unterschiedlicher Ausgangspositionen und Stakeholder-Erwartungen.

Was die Spieltheorie hier am klarsten zeigt: Das Pentagon-Ultimatum war kein Angebot, das man annehmen oder ablehnen konnte. Es war ein Game-Changing Move, der die Spielstruktur selbst veränderte — indem es zwei Unternehmen in eine öffentliche Koordinationsversagen-Situation zwang, aus der nur eines als "kooperativer Staatspartner" hervorgehen konnte, während das andere zwangsläufig die Rolle des principled dissenters übernahm.

Sicher ist eines: Das letzte Wort ist in dieser Angelegenheit noch nicht gefallen. Aber die Relevanz ist bereits jetzt sehr hoch.

Auch deutsche Unternehmen stehen oft vor der Wahl sich aufzustellen, um Staatsprojekte übernehmen zu können oder doch den Konsumentenmarkt zu priorisieren. Und auch in der deutschen Rüstungsindustrie stellen sich ähnliche Fragen.

Es ist daher essentiell von den Direktiven und Motiven anderer zu lernen und seine eigenen Entscheidungen somit zu schärfen.

Deshalb bietet der PRISMA Blog jeden Monat einen Deep-Dive in top-aktuelle Themen der Wirtschaftswelt. Lernen Sie, die von Megakonzernen verursachten Wellen für sich zu nutzen, statt sich von Schlagzeilen treiben zu lassen. Sichern sie ihre Strategie mit belastbaren Daten, anstatt nur auf ihre Intuition zu hören.

Fortschritt im Mittelstand ergibt sich heute mehr denn je aus der Kombination der Anwendung gelernter Methoden und gleichzeitiger Weiterentwicklung derselben.

PS: Wir haben auch ein Youtube-Video zu diesem Artikel gedreht. Falls Sie eine anschaulichere Darstellung der Themen wünschen, dann schauen Sie doch gerne mal auf unserem Prisma Youtube Channel vorbei: Hier gehts zum Kanal